최근 NVIDIA의 데이터센터 GPU와 HBM이 사용되면서 삼성전자, SK하이닉스가 관심을 받고 있습니다.

NVIDIA 주식의 경우 최고가 돌파 후 계속해서 상승하고 있습니다.

우선, NVIDIA 데이터센터 GPU를 알아보고 이어서 HBM을 알아봅시다.

1. 데이터 센터에서 GPU를 사용하는 이유

AI와 데이터 분석에서 고성능 컴퓨팅(HPC)과 렌더링까지 데이터센터는 문제 해결을 위한 열쇠입니다. 하드웨어와 소프트웨어에 걸쳐 통합된 End-to-End NVIDIA 가속 컴퓨팅 플랫폼은 기업에게 모든 최신 워크로드 전체에서 개발에서 배포까지의 구현을 지원하는 강력한 보안 인프라라는 청사진을 제공하는 솔루션입니다.

그렇다면, 데이터 센터에 들어가기 위한 서버용 GPU는 무엇을 말하는걸까요 ?

NVIDIA 데이터센터용 GPU 를 사용하면 높은 사양을 요구하는 HPC 와 하이퍼스케일 데이터센터 워크로드를

가속화 할 수 있으며, 데이터 과학자들과 연구원들은 에너지 탐사부터 AI / Deep Learning 에 이르기까지 다양한 분야들에서 기존의 CPU가 지원햇던 수준을 뛰어넘어 훨씬 더 빠른 페타바이트급 데이터 주문을 처리할 수 있습니다.

기존에 데이터 처리는 전통적으로 CPU에서 진행되었습니다. CPU는 직렬처리방식으로 한번에 하나씩 명령어를 처리하는 방식이죠. GPU의 경우 게임의 그래픽을 처리하는데 사용되었으며 병렬처리방식을 지원하여 그래픽처리에 최적화되어 있습니다.

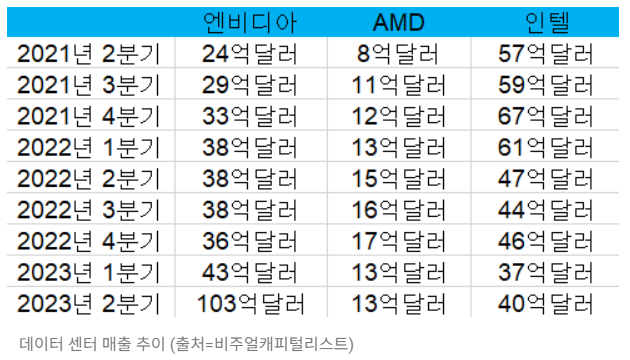

데이터센터에서 AI 지원을 위해서 GPU의 수요가 갑자기 급증하고 있습니다. NVIDIA의 경우 2023년 2분기 103억달러(13조 7000천억원)을 기록, 연초대비 140%나 상승했습니다.

2. NVIDIA 데이터센터 GPU

최신 데이터센터의 AI 및 HPC의 핵심

AI 및 HPC로 세계에서 가장 중요한 과학, 산업 및 비즈니스 과제를 해결합니다. 복잡한 콘텐츠를 시각화하여 최첨단 제품을 만들고, 몰입형 스토리를 전달하고, 미래의 도시를 새롭게 상상합니다. 대규모 데이터세트에서 새로운 인사이트를 추출합니다. 탄력적인 컴퓨팅의 시대에 설계된 NVIDIA Ampere 아키텍처는 모든 규모에서 비교할 수 없는 가속화를 제공하여 이 모든 문제를 해결하고자 합니다.

A100 활용 사례

- 오픈AI는 챗GPT의 학습에 1만 개가 넘는 엔비디아의 ‘A100’ GPU를 활용한 것으로 알려졌다. 엔비디아의 'A100' GPU의 국내 판매 가격은 2500만~3000만원에 달한다.

- 26일 해외 IT매체 애플인사이더 등에 따르면 애플과 코넬대학교 연구진은 10월 오픈소스 기반 LLM '페럿'을 공개했다. 이미지를 쿼리로 활용하는 페럿은 깃허브에 조용히 알려지면서 AI 연구자 사이에서 큰 관심을 모았다.

페럿은 주로 이미지 분석 및 답변에 특화됐다. 사용자가 동물 이미지를 강조 표시하고 페럿에 동물 종을 물으면 모델이 이를 식별하고 답변한다. 해당 LLM은 80GB 메모리를 갖춘 8개의 A100 GPU에서 훈련된 것으로 알려졌다.

- 엔비디아가 네이버 슈퍼컴퓨터 '세종'에 자사 그래픽처리장치(GPU) A100 텐서 코어가 탑재됐다고 15일 밝혔다.

네이버의 두번째 데이터센터 '각 세종'에 구축된 슈퍼컴퓨터 세종은 엔비디아 A100 2240개로 구성된다. A100은 엔비디아 암페어 아키텍처로 구동되며 이전 세대보다 최대 20배 더 높은 성능을 제공한다. 7개 GPU 인스턴스로 구분해 변화하는 수요에 능동적으로 대응할 수 있다.

3. NVIDIA 데이터센터 GPU 가격

A100 모듈 가격은 대당 1만달러(1300만원) 수준이다. 오픈AI가 챗AI 개발에 활용한 슈퍼컴퓨터도 이 GPU 탑재돼 있다. 오픈AI는 GPT-4에 A100 1만개를 활용한 바 있다.

CNBC는 이베이에서 판매되는 H100 가격이 지난해 3만6000달러(4700만원)에서 최근 4만56000달러(6000만원)까지 치솟았다고 최근 보도했다. 올해 초 챗GPT 등장 후 가격이 27.7% 급등한 것이다.

챗GPT와 유사한 LLM을 개발하려는 기업이 급증하면서 H100 수요가 급증했다. 현재 엔비디아에선 늘어난 수요를 감당하지 못하는 상황인 것으로 알려졌다.

※ 2020년 5월까지 사용되던 상표는 Tesla, 모 자동차 회사와 혼동 때문에 폐지

'반도체 > 반도체 주식' 카테고리의 다른 글

| NVIDIA - H100 기업별 구매량 (0) | 2024.02.16 |

|---|---|

| HBM - 예상 가격 및 삼성전자 SK하이닉스 예상 매출 (0) | 2024.02.16 |

| 반도체 수도 만든다 - 4월 총선 양향자 용인갑 예비후보 등록 (8) | 2024.02.15 |